你是否曾幻想过有一个“数字员工”能自动处理飞书消息、同步会议纪要、管理私域任务?OpenClaw(俗称“龙虾”)就是这样一款开源个人 AI 智能体网关,支持本地/云端双模运行,能无缝对接飞书等 IM 平台,让 AI 深度融入你的工作流。

针对 macOS 用户,本文整理了最适合国内环境的部署方案,从环境准备、一键安装到飞书接入、故障排查,全程保姆级指引,即使是新手也能一次成功,告别“部署半小时,报错两小时”的尴尬。

一、部署前必看:系统要求与准备工作

在开始前,确保你的 Mac 满足以下条件,避免踩坑:

| 配置项 | 最低要求 | 推荐配置 | 备注 |

| 操作系统 | macOS 10.15+(Catalina) | macOS 12+(Monterey) | 兼容 Intel 与 Apple Silicon(M1/M2/M3) |

| Node.js 版本 | ≥22.x | 22.12.0 LTS | 官方强制要求,低于 22 会直接报错 |

| 内存 | 8GB+ | 16GB+ | 本地运行大模型需 16GB 以上,仅调用 API 8GB 足够 |

| 网络 | 稳定网络 | 科学上网(可选) | 部分依赖包需从 GitHub 下载,国内网络可能超时 |

| 权限 | 终端管理员权限(sudo) | – | 全局安装依赖与配置后台服务必需 |

提前准备的关键信息

- AI 模型 API Key:推荐准备国内易接入的模型,如 DeepSeek、智谱 GLM-5、MiniMax,注册后即可获取免费额度;

- 飞书开放平台账号:用于创建企业自建应用,实现 OpenClaw 与飞书的双向通信。

- 智谱可以获得2000万免费Tokens,推荐新大家在试验阶段使用智谱GLM模型作为你的openclaw大脑🧠,注册模型链接🔗。注册智谱并完成个人实名认证后,你将获得200万通用模型推理资源包,500万GLM-4.7体验包,1200万GLM-4.5-Air资源包,600万GLM-4.6V资源包,20次图片/视频生成资源,100次搜索资源包,相当于一共获得了2500万tokens。

二、核心部署步骤:三种安装方式,按需选择

OpenClaw 提供三种安装方式,新手优先选一键脚本,开发者可选源码安装,追求环境隔离则选 Docker 部署,全程基于终端操作,复制命令即可。

方式一:一键脚本安装(新手首选,零配置)

官方脚本会自动检测系统环境、安装 Node.js 22、配置依赖,甚至解决 sharp 模块编译问题,堪称“懒人福音”。

- 打开 Mac 终端(Launchpad → 其他 → 终端);

- 执行一键安装命令,国内用户建议添加 sharp 忽略参数,避免编译报错:

SHARP_IGNORE_GLOBAL_LIBVIPS=1 curl -fsSL https://openclaw.ai/install.sh | bash

- 安装过程中会出现安全提示,输入

Yes确认; - 选择配置模式:输入

QuickStart(快速入门),新手无需手动配置复杂参数; - 模型配置:暂时输入

Skip(后续统一配置国内模型,避免引导页适配问题); - 技能与记忆配置:技能选

No(后续按需添加),记忆选Memory(启用长期记忆,支持多轮对话); - 验证安装:执行以下命令,显示版本号即安装成功:

openclaw --version

# 预期输出:OpenClaw 2026.2.26 (bc50708)推荐安装的默认技能,千万不要安装1password的技能,风险太高太高。

🔴 必装核心(所有用户)

- clawhub:技能市场管理,是所有技能的入口,必装。

- summarize:信息提炼神器,支持网页、PDF、视频等多类型内容总结,是提升效率的基础。

- model-usage:监控 AI 模型成本,避免意外超支。

🟡 高价值推荐(产品经理 / 创作者)

- github:代码仓库管理、PR 协作,适合开发者和技术产品经理。

- obsidian:深度集成知识管理,适合构建个人知识库和第二大脑。

- things-mac:任务管理与项目追踪,适合个人和团队工作流。

- apple-reminders:轻量待办提醒,与系统深度集成。

- nano-pdf:快速处理 PDF 文档,提取关键信息。

- openai-whisper:语音转文字,适合会议记录和语音笔记。

🟢 按需安装(根据个人场景)

- 智能家居:

openhue、eightctl、sonoscli - 内容创作:

gifgrep、video-frames、blogwatcher - SaaS 电商:

ordercli - 安全优先:避免安装

1password、oracle等高风险技能,除非有明确且受控的使用场景。

方式二:npm 全局安装(适合已有 Node 环境)

若你已安装 Homebrew 并配置好 Node.js 22,可直接用 npm 安装,更灵活可控。

- 安装 Node.js 22(若已安装,跳过此步):

# 安装 Homebrew(未安装则执行)

/bin/bash -c "$(curl -fsSL https://raw.githubusercontent.com/Homebrew/install/HEAD/install.sh)"

# 安装 Node.js 22

brew install node@22

# 验证版本

node -v # 预期输出:v22.x.x- 全局安装 OpenClaw 稳定版:

由于Openclaw是开源版,社区维护非常频繁,所以建议大家安装稳定版本,命令如下:

sudo npm install -g openclaw@2026.2.25 #安装稳定版本但需要更多兼容性,比如集成飞书等需求的话,请安装最新版命令如下:

npm install -g openclaw@latest #安装最新版本- 初始化新手引导(必做):

openclaw onboard --install-daemon该命令会自动安装 macOS 后台服务(LaunchAgent),实现开机自启,无需每次手动启动。

方式三:Docker 部署(环境隔离,适合多版本测试,多小龙虾养殖方案)

适合需要同时运行多个 OpenClaw 实例,或担心依赖冲突的开发者,需提前安装 Docker Desktop。国内用户可能需要离线包安装Docker(点击查看教程),安装成功后不需要登录,直接使用即可,点击右下角的终端按钮,进入终端模式,如下图。

- 安装 Docker Desktop:从 Docker 官网 下载并安装,启动后验证:

docker --version- 创建数据卷(持久化配置,避免容器删除后丢失):

docker volume create openclaw-data

- 初始化配置:

docker run --rm -v openclaw-data:/root/.openclaw openclaw/openclaw:nightly openclaw setup如果出现“Unable to find image ‘openclaw/openclaw:nightly’ locally”报错,核心原因是 Docker 本地没有这个镜像,且默认从 Docker Hub 拉取失败(国内网络 / 镜像源问题)。

🛠️ 解决方法:换可用镜像 + 适配 Mac 架构

步骤 1:改用官方稳定版镜像(替代 nightly 开发版)

nightly 是每日构建的开发版,稳定性差且国内拉取困难,优先用2026 稳定版,适配 Mac(Intel/M1/M2/M3 全架构):

# 先拉取稳定版镜像(国内可访问)

docker pull openclaw/openclaw:2026.2.25

# 再执行初始化配置(替换 nightly 为 2026.2.25)

docker run --rm -v openclaw-data:/root/.openclaw openclaw/openclaw:2026.2.25 openclaw setup

步骤 2:若仍拉取失败(国内网络问题),用镜像加速

- 打开 Mac 上的 Docker Desktop → 设置 → Docker Engine;

- 粘贴以下镜像加速配置(阿里云 / 网易云任选):

{

"registry-mirrors": [

"https://docker.mirrors.ustc.edu.cn",

"https://hub-mirror.c.163.com",

"https://cr.console.aliyun.com/"

]

}

- 点击「Apply & Restart」重启 Docker;

- 重新执行拉取命令:

docker pull openclaw/openclaw:2026.2.25

步骤 3:Mac Apple Silicon(M1/M2/M3)额外适配

若你的 Mac 是苹果自研芯片,需添加 --platform linux/amd64 兼容架构:

# M 系列芯片专用拉取命令

docker pull --platform linux/amd64 openclaw/openclaw:2026.2.25

# M 系列芯片专用初始化命令

docker run --rm --platform linux/amd64 -v openclaw-data:/root/.openclaw openclaw/openclaw:2026.2.25 openclaw setup- 最后启动容器(映射 18789 端口,用于浏览器访问 UI):

docker run -d --name openclaw -p 18789:18789 -v openclaw-data:/root/.openclaw --restart unless-stopped openclaw/openclaw:nightly三、关键配置:接入国内模型 + 飞书,让 AI 真正可用

安装完成后,核心是配置模型与飞书通道,这是 OpenClaw 能“干活”的关键。本文以智谱 GLM-5 和 飞书 为例,适配国内用户需求。

第一步:配置国内 AI 模型(以智谱为例)

- 打开 OpenClaw 配置界面:

openclaw config- 选择

Models→Add Model,输入以下参数(直接复制):

| 参数名 | 取值 |

| Provider | zhipu |

| Model ID | glm-4.5-air(免费额度足够) |

| API Key | 你的智谱 API Key(从智谱开放平台获取) |

| Base URL | https://open.bigmodel.cn/api/paas/v4/ |

3. 保存配置,执行 openclaw doctor --fix,自动修复配置错误。 |

第二步:飞书接入(核心!无需公网 IP)

OpenClaw 支持飞书 WebSocket 长连接,无需暴露公网端口,本地即可实现消息互通。

1)创建企业自建应用

打开飞书开放平台 https://open.feishu.cn/app,点击“创建企业自建应用”,填写名称、描述和图标。

飞书后台创建应用入口。

2)复制应用凭证

进入“凭证与基础信息”,复制并保存 App ID(例如 cli_xxx)和 App Secret。

请妥善保管 App Secret,避免泄露。

3)批量导入应用权限

在“权限管理”页点击“批量导入”,粘贴下方权限 JSON(官方推荐),然后提交。

{ "scopes": { "tenant": [ "contact:contact.base:readonly", "aily:file:read", "aily:file:write", "application:application.app_message_stats.overview:readonly", "application:application:self_manage", "application:bot.menu:write", "cardkit:card:write", "contact:user.employee_id:readonly", "corehr:file:download", "docs:document.content:read", "event:ip_list", "im:chat", "im:chat.access_event.bot_p2p_chat:read", "im:chat.members:bot_access", "im:message", "im:message.group_at_msg:readonly", "im:message.group_msg", "im:message.p2p_msg:readonly", "im:message:readonly", "im:message:send_as_bot", "im:resource", "sheets:spreadsheet", "wiki:wiki:readonly" ], "user": [ "aily:file:read", "aily:file:write", "contact:contact.base:readonly", "im:chat.access_event.bot_p2p_chat:read" ] } }

导入后请检查关键权限是否都在“已申请”状态。

4)启用机器人能力

打开“应用能力 > 机器人”,启用机器人并设置机器人名称。

机器人名称建议与 OpenClaw 应用场景保持一致。

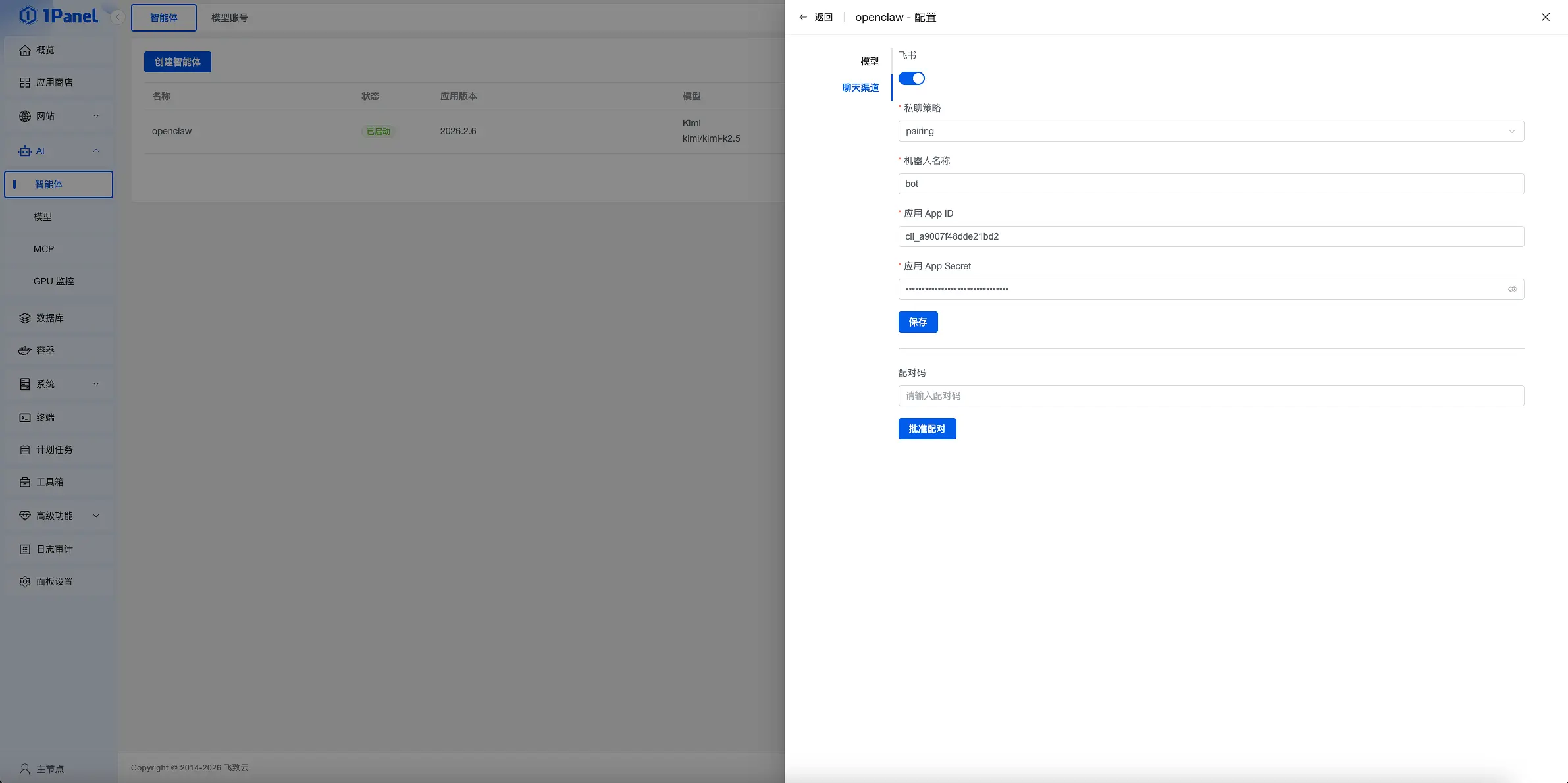

5)在 1Panel 中配置飞书

打开“智能体 > 配置”,在聊天渠道中启用飞书,并填写 App ID 和 App Secret。

6)配置事件订阅(长连接)

进入“事件订阅”,选择“使用长连接接收事件(WebSocket)”,并添加事件 im.message.receive_v1。

若保存失败,优先检查 OpenClaw 网关是否正在运行。

7)发布应用

在“版本管理与发布”中创建版本并提交发布,等待企业管理员审批(企业自建应用通常可快速通过)。

1. 飞书开放平台创建应用

- 登录 飞书开放平台,点击「创建企业自建应用」,填写名称(如“我的 AI 助手”);

- 记录应用的

App ID和App Secret(后续配置必需); - 开通权限:进入「权限管理」→「应用身份权限」,开通以下必需权限:

im:message(收发消息)im:message.group(群消息权限)contact:user(获取用户信息)

- 配置事件接收:进入「事件与回调」,选择「长连接接收事件」,保存即可。

2. OpenClaw 配置飞书通道

- 执行通道添加命令:

openclaw channel add feishu- 按提示输入:

- App ID:飞书应用的 App ID

- App Secret:飞书应用的 App Secret

- Encrypt Key:留空(无需加密)

- Verification Token:留空

- 启动飞书通道:

openclaw channel start feishu- 验证:在飞书里给应用发消息,若 OpenClaw 终端输出消息日志,即对接成功。

四、启动与管理:Mac 专属命令速查

部署完成后,掌握以下命令,轻松管理 OpenClaw 服务。

核心启动/停止命令

# 启动网关(核心服务)

openclaw gateway start

# 查看网关状态(确认是否运行)

openclaw gateway status

# 停止网关

openclaw gateway stop

# 重启网关(配置修改后执行)

openclaw gateway restart后台常驻与开机自启

# 安装后台服务(开机自启)

openclaw onboard --install-daemon

# 查看后台服务状态

launchctl list | grep openclaw

# 停止后台服务

launchctl stop ai.openclaw.gateway日志查看与问题排查

# 查看实时日志(排查错误必备)

tail -f ~/.openclaw/logs/gateway.log

# 清理锁文件(解决网关卡死)

find ~/.openclaw -name "*.lock" -delete五、避坑指南:Mac 部署常见问题与解决方案

针对 macOS 用户的高频报错,整理了以下解决方案,遇到问题直接对照处理。

| 问题现象 | 原因 | 解决方案 |

安装时提示 npm install failed | 网络超时或 Node 版本过低 | 1. 切换国内 npm 镜像:npm config set registry https://registry.npmmirror.com/;2. 确认 Node 版本 ≥22,重新安装 |

| sharp 模块编译错误 | Apple Silicon 架构兼容问题 | 执行 SHARP_IGNORE_GLOBAL_LIBVIPS=1 npm install -g openclaw --force 重装 |

终端输入 openclaw 提示 command not found | 安装路径未加入 PATH | 1. 新开终端;2. 执行 source ~/.zshrc(或 ~/.bash_profile);3. 手动添加路径:export PATH="$HOME/.npm-global/bin:$PATH" |

| 飞书消息无响应 | 权限不足或通道未启动 | 1. 检查飞书应用权限是否开通;2. 执行 openclaw channel start feishu 重启通道;3. 查看日志:tail -f ~/.openclaw/logs/channel-feishu.log |

| 网关启动后立即崩溃 | 锁文件残留 | 执行 find ~/.openclaw -name "*.lock" -delete 清理锁文件,再重启网关 |

六、进阶玩法:让 OpenClaw 适配你的工作流

部署完成后,结合你的 工作场景,可通过以下方式提升效率:

- 私域任务自动化:添加「文档处理」技能,自动将飞书客户需求整理成 Excel 报表,同步到你的工作工具;

- 本地模型部署:安装 Ollama,部署 Qwen2.5-7B 本地模型,告别 API 额度焦虑,数据完全本地化;

- 定时任务:配置每日 9 点自动推送行业资讯、18 点汇总私域成交数据,解放双手。

结语

在 AI 赋能办公的时代,OpenClaw 为 macOS 用户提供了“零门槛、高定制”的个人 AI 助手解决方案。只需 30 分钟,就能完成从部署到飞书接入的全流程,让 AI 真正融入你的工作流,实现消息处理、任务管理、文档生成的自动化。

现在,打开你的 Mac 终端,输入一键安装命令,开启你的 AI 办公升级之旅吧!

原创文章,作者:产品大法师 ,如若转载,请注明出处:https://www.pmtemple.com/artificial-intelligence/18150/

,如若转载,请注明出处:https://www.pmtemple.com/artificial-intelligence/18150/

微信扫一扫

微信扫一扫  支付宝扫一扫

支付宝扫一扫